La asequibilidad de Deepseek es un mito: la IA revolucionaria en realidad costó $ 1.6 mil millones para desarrollarse

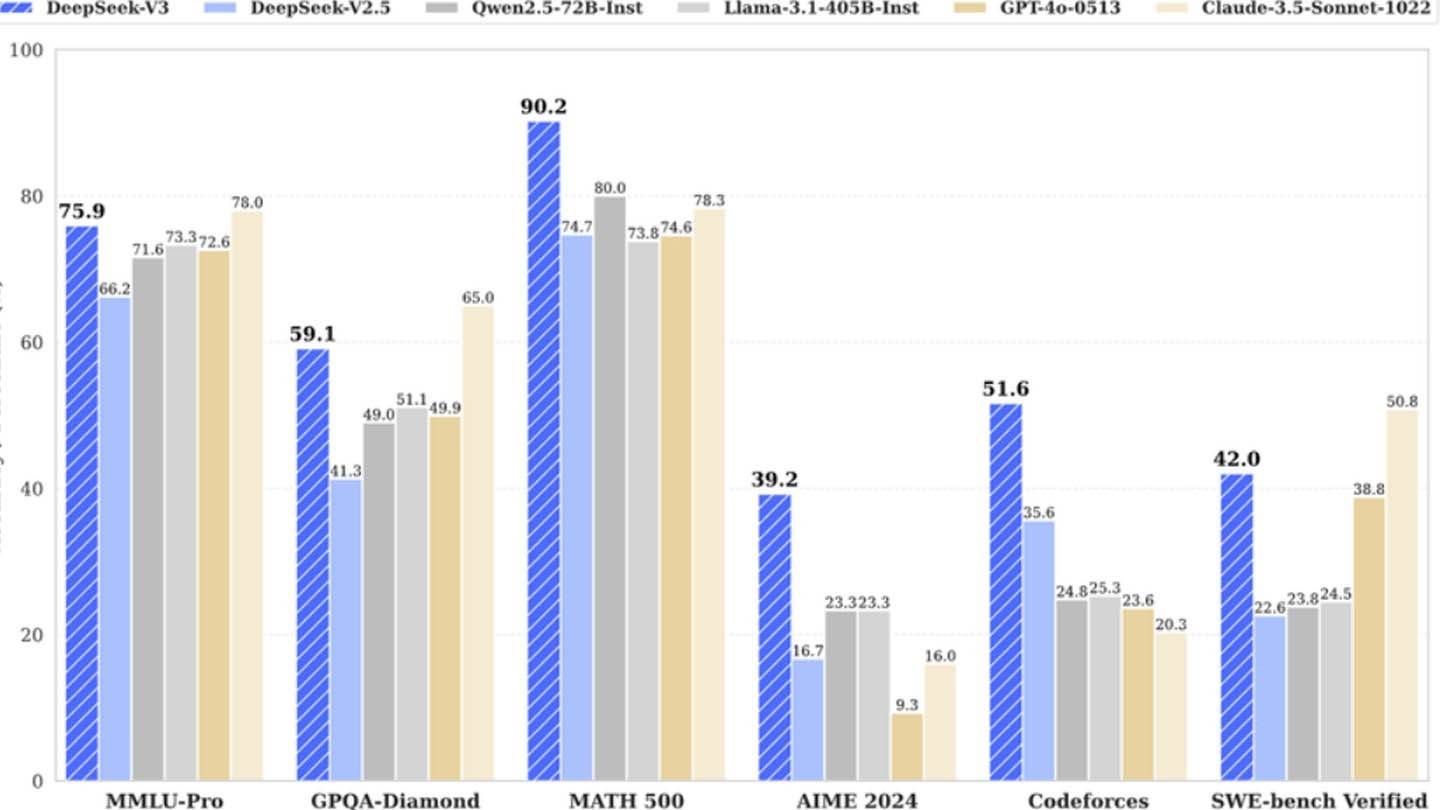

El nuevo chatbot de Deepseek cuenta con una introducción impresionante: "Hola, fui creado para que puedas preguntar cualquier cosa y obtener una respuesta que incluso te sorprenda". Esta IA, un producto de la startup china Deepseek, se ha convertido rápidamente en un jugador importante, incluso contribuyendo a una caída significativa en el precio de las acciones de Nvidia. Su éxito proviene de una metodología única de arquitectura y capacitación que incorpora varias tecnologías innovadoras.

Predicción de múltiples token (MTP): a diferencia de los modelos tradicionales que predicen una palabra a la vez, MTP predice múltiples palabras simultáneamente, analizando diferentes piezas de oraciones para mejorar la precisión y la eficiencia.

Mezcla de expertos (MOE): esta arquitectura utiliza múltiples redes neuronales para procesar datos de entrada, acelerar la capacitación y mejorar el rendimiento. Deepseek V3 emplea 256 redes, activando ocho para cada token.

Atención latente múltiple (MLA): este mecanismo se centra en elementos de oraciones cruciales, extrayendo repetidamente detalles clave de fragmentos de texto para minimizar la pérdida de información y capturar matices sutiles.

Inicialmente, Deepseek afirmó haber entrenado su poderosa red neuronal de Deepseek V3 por solo $ 6 millones utilizando 2048 GPU. Sin embargo, el semianálisis reveló una infraestructura mucho más extensa: aproximadamente 50,000 GPU de la tolva NVIDIA, incluidas 10,000 H800, 10,000 H100 y H20 adicionales, distribuidos en múltiples centros de datos. Esto representa una inversión de servidor total de aproximadamente $ 1.6 mil millones, con gastos operativos estimados en $ 944 millones.

Deepseek, una subsidiaria del fondo de cobertura de alto flyer, posee sus centros de datos, a diferencia de muchas nuevas empresas que dependen de los servicios en la nube. Esto proporciona un mayor control sobre la optimización y la implementación de innovación más rápida. La naturaleza autofinanciada de la compañía mejora la flexibilidad y la velocidad de toma de decisiones. Además, Deepseek atrae al máximo talento, y algunos investigadores ganan más de $ 1.3 millones anuales, principalmente de las universidades chinas.

Si bien el reclamo inicial de los costos de capacitación de $ 6 millones parece poco realista, la referencia solo al uso previo al uso de GPU y excluyendo la investigación, el refinamiento, el procesamiento de datos e infraestructura, DePseek ha invertido más de $ 500 millones en desarrollo de IA. Su estructura compacta facilita la implementación de innovación eficiente en comparación con las empresas más grandes y burocráticas.

El éxito de Deepseek destaca el potencial competitivo de las compañías de IA independientes bien financiadas. Sin embargo, sus logros se basan en una inversión sustancial, avances tecnológicos y un equipo fuerte, lo que hace que el "presupuesto revolucionario" reclame una simplificación excesiva. A pesar de esto, los costos de Deepseek siguen siendo significativamente más bajos que los competidores; Por ejemplo, su capacitación en modelo R1 costó $ 5 millones, en comparación con los $ 100 millones de Chatgpt 4. Sin embargo, sigue siendo más barato que sus competidores.

-

Firaxis Games has confirmed a round of layoffs affecting an unspecified number of employees across multiple departments—including production, narrative, and art—amid ongoing restructuring at the studio. The news comes despite Take-Two Interactive CEOAutor : Joshua Mar 12,2026

-

Absolutely — Lumines Arise, the long-awaited evolution of the iconic Lumines series, has officially made its grand return at Sony’s State of Play June 2025 showcase, sending shockwaves through the gaming world with its stunning debut. Developed by TeAutor : Stella Mar 08,2026

-

Kitty LetterDescargar

Kitty LetterDescargar -

SwingShotDescargar

SwingShotDescargar -

The Seven Realms 3Descargar

The Seven Realms 3Descargar -

Curse of the Night Stalker - Chapter 3 releaseDescargar

Curse of the Night Stalker - Chapter 3 releaseDescargar -

My Home Design: My House GamesDescargar

My Home Design: My House GamesDescargar -

100+ RiddlesDescargar

100+ RiddlesDescargar -

Elite PokerDescargar

Elite PokerDescargar -

Sinful Summer: A Tale of ForbiddenDescargar

Sinful Summer: A Tale of ForbiddenDescargar -

Monster Girl 1000Descargar

Monster Girl 1000Descargar -

1-19 Number GameDescargar

1-19 Number GameDescargar

- HoYo Fest 2025: Novedades sobre el regreso

- Dominar armas de dos manos en Elden Ring: una guía

- Ultimate Guide to Shinigami Progresion in Hollow Era

- Roblox Códigos de simulador: ¡Desbloquea recompensas exclusivas!

- Olas borrascosas: descubre los secretos de la paleta de Whisperwind Haven

- Top 25 Mods de Palworld para mejorar tu juego

-

1Los mejores reproductores multimedia para transmisión suave

-

2Aplicaciones de suscripción de revista imprescindible

-

3Juegos casuales adictivos para todos

-

4Mejores juegos de estrategia de acción para Android

-

5Las mejores aplicaciones de estilo de vida para mejorar su vida

-

6Essential Beauty Apps for Wellness